En la actualidad, los avances tecnológicos con inteligencia artificial, han hecho que las empresas en todos los sectores tengan que implementar diferentes herramientas con el fin de seguir a la vanguardia y, asimismo, optimizar sus procesos en las operaciones cotidianas.

También, han obligado a las compañías, sobre todo del sector bancario, ha implementar nuevas estrategias de seguridad porque los delincuentes han logrado usar métodos basados con IA generativa para poder hackear o estafar, tanto a personas como organizaciones, por medio de la suplantación de identidad.

En ese sentido, Valora Analitik habló con Daniel Miolina, vicepresidente de Iproov para Latinoamérica, sobre la importancia de contar con sistemas de seguridad que ayuden a prevenir dichas estafas a las empresas y personas naturales.

Molina empezó con tres preguntas de seguridad básicas que plantea para prevenir alguna estafa en cuanto a la suplantación de identidad con herramientas de IA generativa: ¿Eres o no un ser humano vivo? ¿Eres o no el ser humano correcto? ¿Estas haciendo esta transacción remotamente en tiempo real?

Suena muy básico, dijo Molina, pero son preguntas que ayudan a generar confianza. “Imagínate si tú eres un banco y tienes que abrir una cuenta para un usuario que no puede ir a tu oficina, ¿Cómo lo haces? ¿Cómo compruebas quién eres en el ámbito digital? Entonces, el concepto de la identidad digital, es algo que nos lleva al futuro”.

“Y es que si tú te pones a pensar lo que compartes y cómo lo compartes acerca de ti, te das cuenta de que estas regalando mucha información cuando no debes”, explica Daniel Molina.

Bajo ese contexto, es importante ser conscientes de los datos que las personas exponen diariamente en los diferentes canales, ya que los deepfakes, los metadatos falsificados y los ataques de inyección digital, son algunos de los ataques biométricos más frecuentes que se están presentando en la actualidad con herramientas de IA generativa.

También, tener en cuenta que América Latina ocupa el segundo lugar después del Sudeste Asiático y pierde el 20 % de sus ingresos totales a causa del fraude cada año. Una de cada cinco transacciones de comercio electrónico se rechaza por ser fraudulenta. Eso es el doble que en cualquier otro lugar del planeta.

¿por qué es importante según IProov prevenir los ataques biométricos?

“Las herramientas avanzadas de IA generativa ya no son cosa del futuro y no lo han sido durante meses en nuestra región. “Los actores de amenazas pueden crear identidades sintéticas avanzadas y altamente sofisticadas que son increíblemente realistas y casi imposibles de detectar con el ojo humano sin herramientas y monitoreo altamente complejos en la actualidad”, dijo Molina.

Alguna vez se consideró que las plataformas móviles eran más fáciles de defender debido a las inversiones en aplicaciones móviles y desarrollo de seguridad de software, pero un informe de iProov sugiere que ya no es así.

Le puede interesar: ¿Ha recibido correos para proporcionar sus datos bancarios? Así puede reconocer el fraude y reportarlo

Los investigadores dijeron que hubo un aumento del 149 % en los ataques dirigidos a dispositivos y plataformas móviles en la segunda mitad de 2022 en comparación con la primera mitad. “Este crecimiento se debe en parte a la importancia de los dispositivos móviles para la seguridad biométrica, así como al uso de emuladores que se hacen pasar por dispositivos móviles e imitan su comportamiento”, dijo Molina.

Siguen creciendo nuevos métodos de ataques con IA

Cada año, los delincuentes desarrollan nuevas amenazas para eludir los sistemas de seguridad, siendo el «intercambio de caras» una iteración nueva y más sofisticada que surgió por primera vez el año pasado. El intercambio de rostros combina la imagen del rostro de la víctima con un video sintético para falsificar tanto la vida como el software de autenticación pasiva.

Los deepfakes son un tipo de ataque de inyección digital, en el que los piratas informáticos pasan por alto las cámaras utilizadas para la verificación de identidad e insertan imágenes sintéticas, deepfakes o incluso grabaciones de vídeo en los sistemas de autenticación.

También se han vuelto muy frecuentes; de hecho, los ataques de inyección digital ahora ocurren cinco veces más a menudo que los ataques de presentación, que es cuando los delincuentes verifican una identidad mostrando una fotografía o una máscara a un sistema.

Estas amenazas solo evolucionarán, especialmente a medida que la tecnología de inteligencia artificial generativa como ChatGPT mejore sus capacidades. “Con la última versión de ChatGPT experimentando con indicaciones de imágenes”, dijo Molina, “el uso de tecnología generativa para producir avatares de apariencia humana para identidades sintéticas para sortear las pantallas biométricas es inevitable”, agrega.

¿Cómo pueden las organizaciones defenderse de los deepfake?

A medida que más organizaciones trasladan sus servicios en línea y maduran los proyectos de transformación digital e identidad digital, la necesidad de una verificación y autenticación sólidas de los usuarios solo aumentará en importancia.

Los métodos de verificación tradicionales no han logrado mantener a los usuarios seguros en línea y no se puede confiar únicamente en los datos como confirmación de quién es alguien. Las contraseñas se pueden descifrar, robar, perder o compartir.

Lea también: Genius, la herramienta de IA que ayuda a la gestión de capital humano en las empresas

Las OTP pueden ser interceptadas, particularmente cuando aprovechan la frágil infraestructura de SMS. La verificación de videollamadas puede ser falsificada y, a menudo, depende de un juicio manual, que ya no puede distinguir de manera confiable entre imágenes genuinas y sintéticas.

Por tanto, la verificación biométrica se ha convertido en el único método seguro y conveniente para verificar la identidad del usuario en línea. Sin embargo, no todas las soluciones biométricas son iguales.

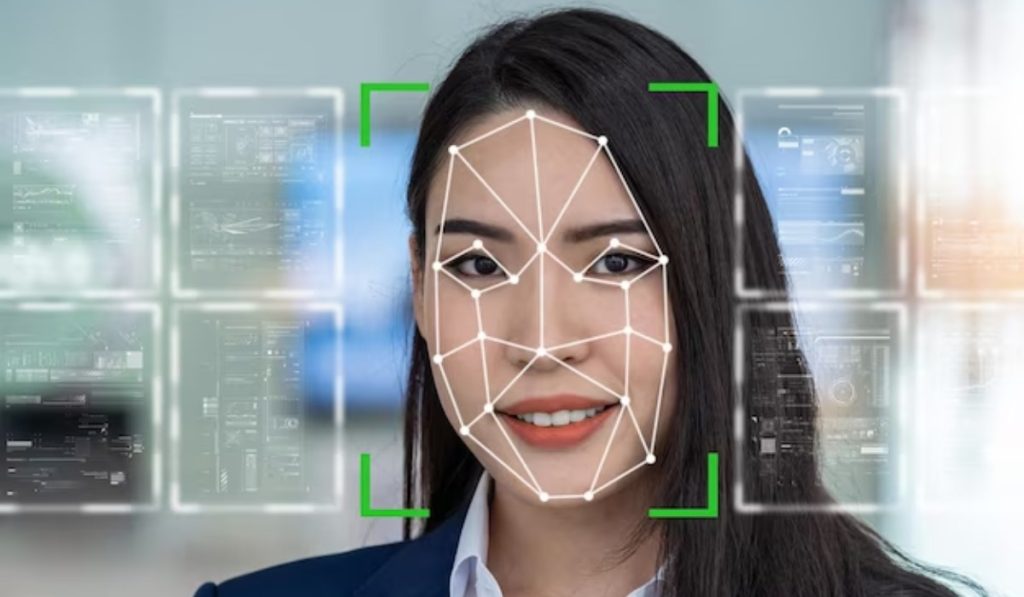

La verificación de identidad biométrica es un proceso de identificación de personas en función de sus características biológicas únicas, como huellas dactilares, verificación facial, reconocimiento de voz o escaneo del iris.

Es una forma altamente confiable y segura de verificar la identidad de una persona y minimiza o elimina la necesidad de contraseñas o métodos de autenticación convencionales, que son más fáciles de piratear o robar.

Para dispositivos de uso general, como teléfonos inteligentes o computadoras portátiles, un enfoque incorrecto es indicarle al usuario que haga algo diferente cada vez que se autentica.

El usuario puede realizar acciones como girar la cabeza o leer una secuencia de caracteres en voz alta para verificar que está “vivo” en el momento de la autenticación.

Sin embargo, los deepfakes se pueden codificar fácilmente para realizar estas acciones a escala, y tan bien como un ser humano, invalidando así la “vivacidad” de dichos pasos adicionales.

Además, pueden surgir problemas de accesibilidad e inclusión cuando se pide a las personas que sigan las instrucciones en la pantalla. En general, cada paso activo perderá un porcentaje de usuarios que abandonen el proceso y vuelvan a una experiencia presencial o a un servicio de asistencia técnica.

El método más eficaz para defenderse de los ataques de inyección digital es crear una biometría facial única. En ese sentido, lo que plantea IProov con base en dicha situación, es que se vuelve indispensable saber que el cliente en línea sea la persona adecuada (y no un impostor), la persona real (no una falsificación) y se esté autenticando en este momento (utilizando un biométrico de un solo uso) bajo las soluciones que plantea la empresa por medio de sus herramientas.

Estas herramientas utilizan tecnología de visión por computadora para detectar la presencia genuina de un usuario vivo.

Un código biométrico de un solo uso le indica al dispositivo que ilumine el rostro del individuo con una secuencia impredecible de colores para establecer la autenticidad en tiempo real.

El mecanismo de desafío-respuesta es aleatorio, lo que hace que el proceso de autenticación sea impredecible, resistente a la repetición de ataques y muy difícil de aplicar mediante ingeniería inversa.

Esto ayuda a las organizaciones a verificar que alguien es quien dice ser, en lugar de una representación como una fotografía o una máscara o una parodia basada en IA generativa como una identidad sintética.

También analiza información multidimensional derivada del comportamiento facial, así como otros datos contextuales para garantizar una identidad integral y mitigar el riesgo de fraude de identidad.

La tecnología de verificación biométrica, en particular, puede permitir a los bancos ofrecer una experiencia de usuario sin esfuerzo, maximizar la inclusión de los clientes, reducir la frustración de los usuarios y brindar la seguridad necesaria para protegerse contra el fraude y al mismo tiempo respaldar el cumplimiento de las regulaciones.

A medida que avanzan las amenazas, corresponde al sector financiero intensificar su juego para proteger a sus titulares de cuentas y, lo que es más importante, a sus accionistas de estas actividades que podrían causar un daño sustancial al valor del banco.